Le Blog

L’endroit parfait pour ne rien manquer de notre actualité

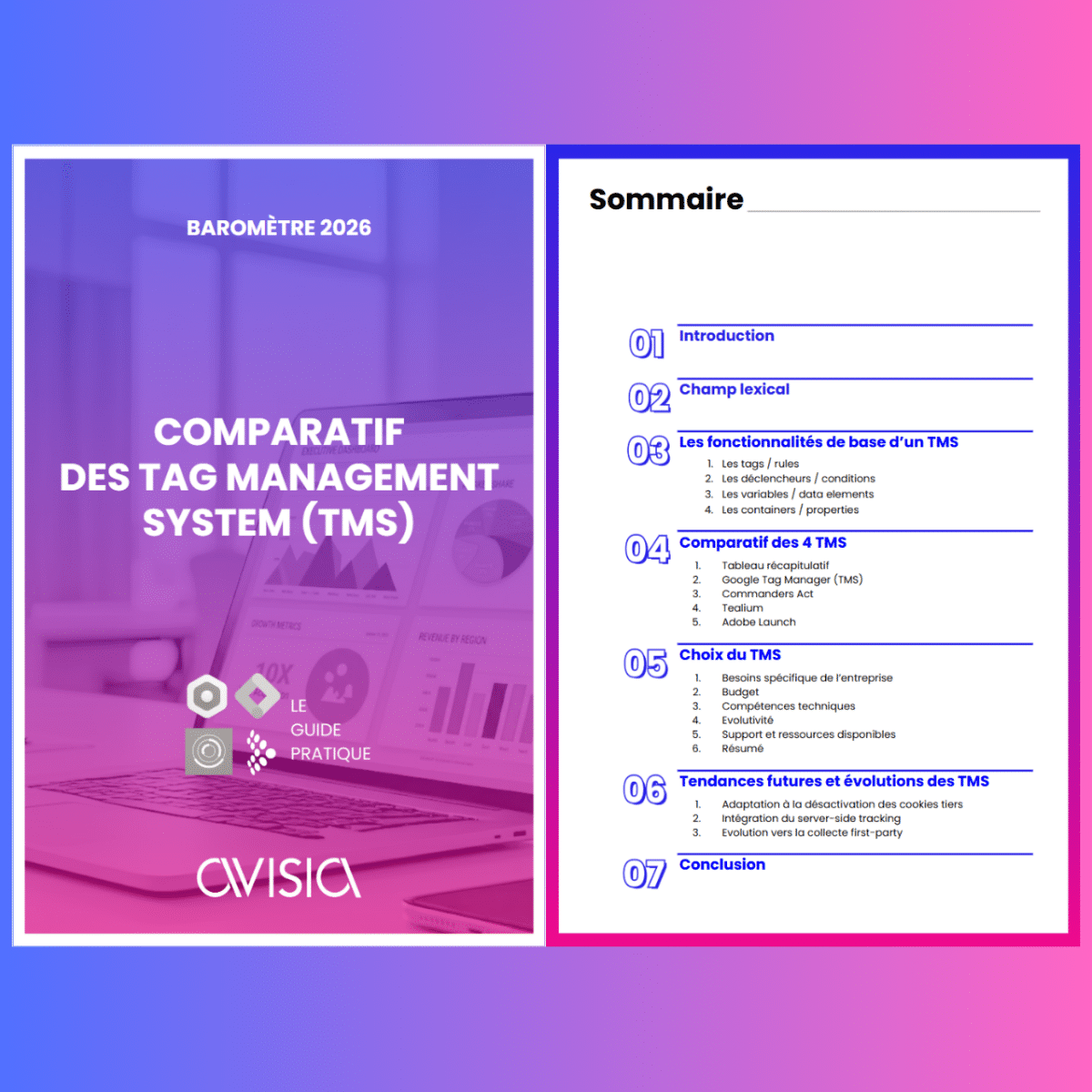

Dans un écosystème digital où la donnée est à la fois l’atout le plus précieux pour votre business et le plus réglementé, le choix du...

Le 14 avril dernier, les locaux de la BNP Paribas ont vibré au rythme de l’innovation à l’occasion de l’IMA GEN AI. Un rendez-vous intense...

L’IA est aujourd’hui un enjeu majeur de souveraineté et de compétences. Notre mission est claire : rendre cette technologie intelligible, éthique et accessible à tous,...

Retour sur Dataquitaine 2026 : FLOA et AVISIA au cœur de l’IA responsable et du MLOps AVISIA a renouvelé son engagement pour cette 9ème édition...

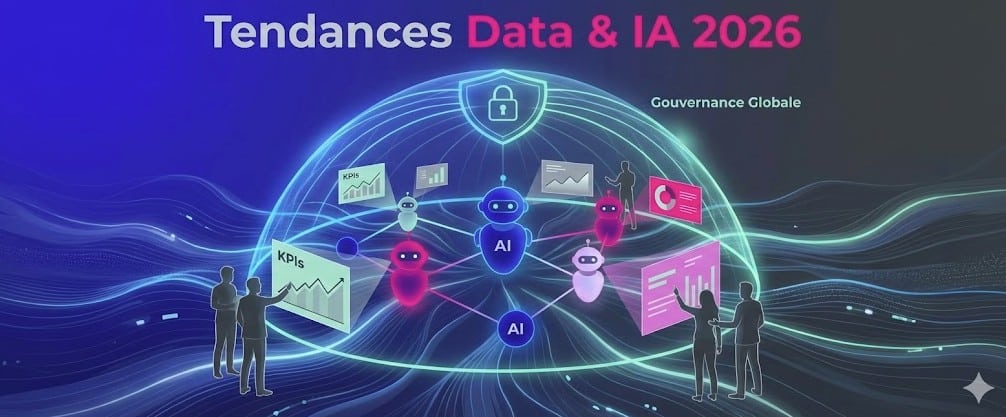

L’année 2025 a été celle de l’acculturation et des premiers succès autour de l’IA Générative. Les entreprises ont multiplié les assistants virtuels, les PoC basés...

Construire l’avenir ensemble : zoom sur nos partenariats écoles chez AVISIA Chez AVISIA, nous sommes convaincus que l’innovation et notre développement passent par les talents...

Le paysage de la donnée en France vit un tournant historique. Entre souveraineté numérique et accélération de l’IA, les entreprises cherchent le point d’équilibre parfait....

Ce 27 janvier 2026, au cœur des bureaux de Google France, AVISIA a réuni les décideurs de la Data pour une conférence exclusive : la...

L’année 2026 marque un tournant définitif pour l’Intelligence Artificielle en entreprise. Nous assistons à la fin des prototypes isolés et de la Business Intelligence statique...

Depuis 2014, le partenariat entre AVISIA et Dataiku repose sur une ambition commune : transformer la donnée en levier de croissance stratégique. En 2025, cette...

Chez AVISIA, la performance ne se mesure pas seulement en algorithmes ou en KPIs business. Elle se mesure aussi via notre impact sociétal et environnemental....

Les événements Data & IA à ne pas manquer Focus sur les salons du 1er semestre dédiés au numérique, à l’Intelligence Artificielle et à la...

Chez AVISIA, nous accompagnons nos clients dans la maîtrise des enjeux RSE. Nous les aidons ainsi à intégrer des pratiques numériques plus responsables. En effet,...

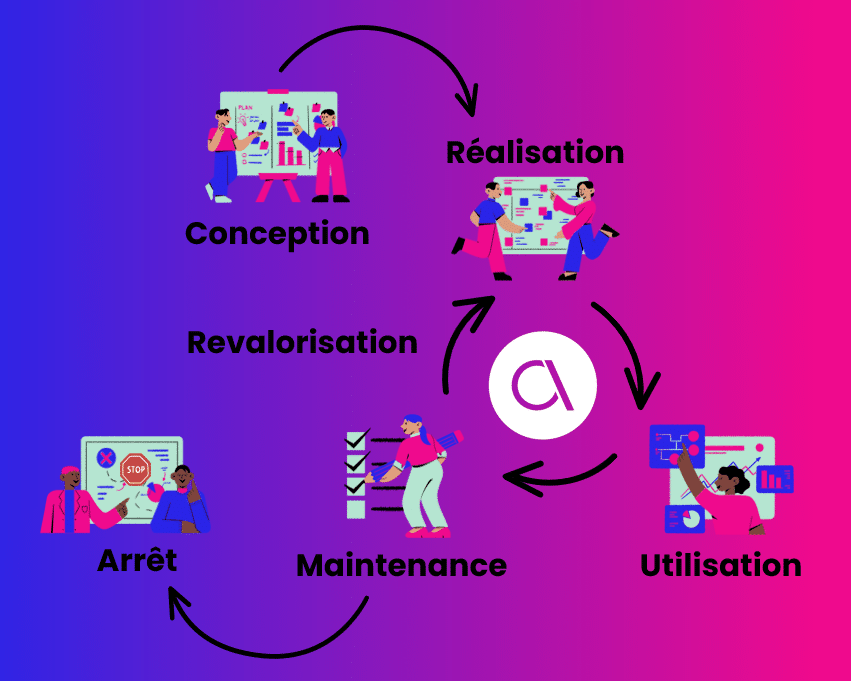

Depuis 2007, AVISIA accompagne les entreprises de tous secteurs dans leurs projets data. Gouvernance, Analyse, modèles de prédictions, l’arrivée de l’IA générative a été un...

Samedi 6 décembre, Hinaupoko Devèze, Miss Tahiti, a été couronnée Miss France 2026. C’est plus de 6 millions de personnes qui ont suivi l’événement devant...

Nous sommes aujourd’hui à J-5 de l’élection Miss France 2026, qui se tiendra ce samedi soir en direct du Zénith d’Amiens sur TF1. Pour cette...

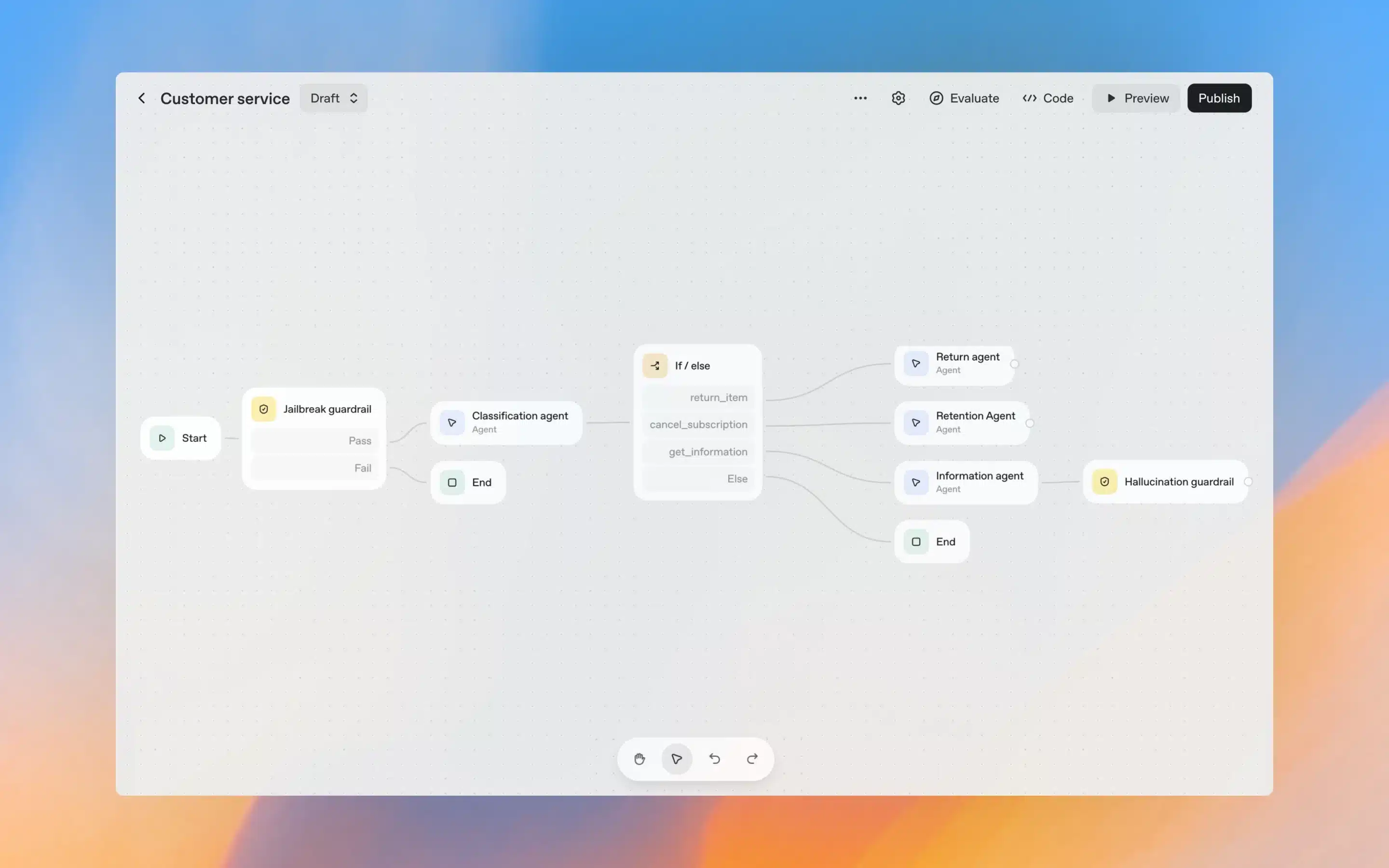

Mise en place d’une stratégie Agentique à grande échelle : comment orchestrer, gouverner, maintenir des agents efficients en 2026 ? L’IA Agentique a peuplé notre...

AVISIA Training : Être formé par nos experts AVISIA, Cabinet de référence Data & IA depuis 2007, transforme le savoir-faire terrain en formation actionnable. Nous...

Chaque année depuis 2017, le Data Lab’ AVISIA relève un défi original : prédire la future Miss France selon le vote du public grâce à...

Le 25 septembre 2025, AVISIA était présent au Dataiku Summit à Paris. Ce fut l’occasion pour notre équipe présente sur place de rencontrer des professionnels...

CONTEXTE Le monde de l’analytique évolue et change, de nombreuses entreprises font le choix aujourd’hui de migrer de plateforme vers Dataiku. Ainsi, celles-ci se présentent...

Après avoir exploré le modèle de Marketing Mix Modeling (MMM) proposé par Google avec Meridian, nous poursuivons notre série avec une plongée dans l’approche développée...

Le 16 septembre 2025, AVISIA était présent au salon de la Data et de l’IA à Nantes. Ce fut l’occasion pour notre équipe présente sur...

Les agents IA, ces systèmes capables de raisonner, d’agir et de dialoguer avec des outils ou des bases de données, sont en train de devenir...

Agentique IA : Découvrez notre Livre Blanc exclusif ! L’intelligence artificielle évolue à une vitesse fulgurante, et au cœur de cette transformation se trouve l’Agentique...

Introduction – L’aube d’un nouvel âge pour l’IA en entreprise Ce mardi 30 septembre 2025 s’est tenue la Matinale Réveil Tech – L’Aube de l’Agentic...

Mesurer l’efficacité de son budget marketing n’a jamais été aussi crucial – ni aussi complexe. Après avoir exploré les différentes approches de Marketing Mix Modeling...

Quatre ans après notre premier rapport RSE, AVISIA franchit une nouvelle étape dans son engagement pour un développement durable et responsable. Une maturité assumée, des...

Dans notre dernier article, nous avons passé en revue les différentes approches de mesure de la performance marketing. Aujourd’hui, focus sur l’une d’entre elles :...

Une nouvelle étape dans l’IA ? Depuis quelque temps, un terme revient de plus en plus souvent dans les articles tech, les conférences et même...

Data contact

Avec notre expertise, faites parler vos données